让"VSCode+Claude/Copilot"通过API接入DeepSeek V4

本文记录笔者于2026.04.27,在自己的VSCode+Claude Code/Github Copilot工作方案上,通过DeepSeek API接入deepseek-v4-pro的尝试过程。

为啥要干这个

笔者在之前一直用的是“VSCode + Github Copilot”的工作方案,蹭了学生优惠,免费用了一段时间的GPT-5.3-Codex。

近期突然发现Copilot对账号加了非常严格的使用限制,不仅一段时间内使用会超限(再次使用要等几个小时),而且每周也加了使用限制(超过限制就只能选auto模型),不再像以前那样只有每月的限制(本来以我的使用习惯,根本用不完)。

然后我就上网找到了这个文章和这个讨论帖,大致了解了一下发生了啥。

我只能说,Copilot这样一改,直接让我失去使用它的最重要理由了,但是作为原生内置插件,Copilot和VSCode的相性最好,不舍得换。恰好DeepSeek V4近期发布,而我用DeepSeek API的开销可以报销,值得一试。于是我尝试了一些在Copilot上使用DeepSeek模型的方案。如果Copilot行不通,用Claude Code的壳子也不是不行。

前置条件

- VSCode是主力开发工具。其他IDE很难参考这些方法。

- 有DeepSeek的API。

- VSCode上已经安装了插件GitHub Copilot Chat。

- VSCode上已经安装了插件Claude Code for VS Code。

(失败) 让Github Copilot使用DeepSeek API

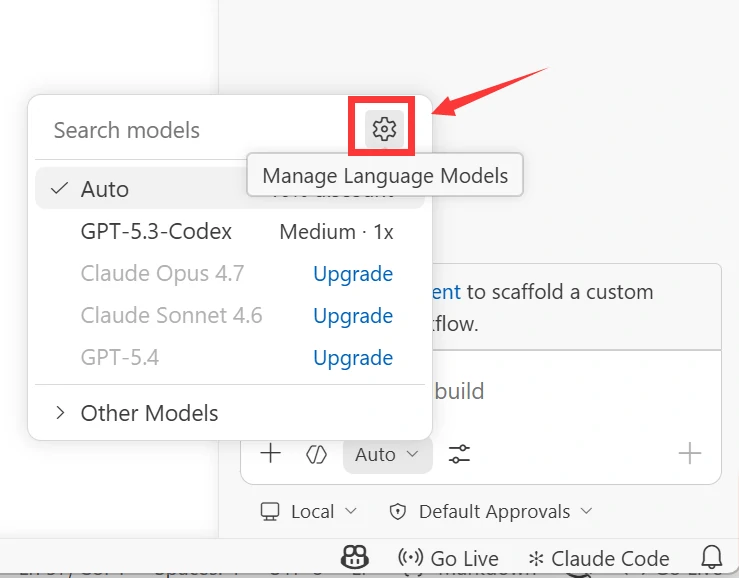

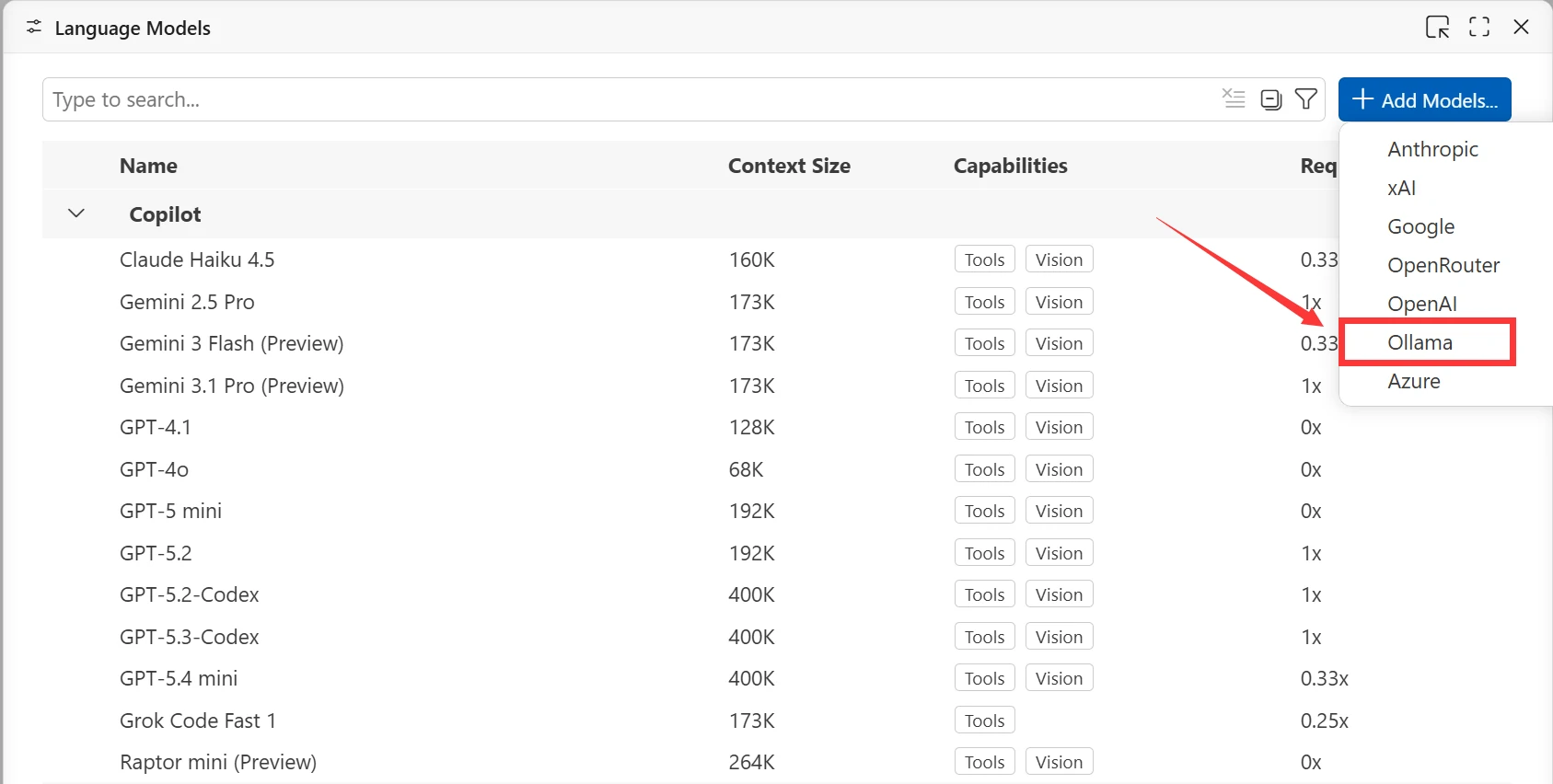

目前Github Copilot的模型管理页面,对第三方模型的支持非常少,而且不能修改Base URL,所以没办法通过直接填DeepSeek API key的方式去添加DeepSeek模型。

方法就是使用一个npm的包o2lma,它的作用是充当一个代理服务器,自动把DeepSeek API的Base URL访问封装成对本地Ollama API格式的Base URL的访问,同时在这个本地端口上监听与转发请求。

在终端敲下列命令:

1 | # 安装o2lma(前提是电脑上有Node.js) |

上述命令敲完,在Copilot的模型管理页面,选择Add Models...,下拉列表选Ollama,然后按照要求把信息填上(没啥有用信息,第一个信息是分类备注,爱写啥写啥,第二个信息是Base URL,保持原样就行,主机是localhost,端口只要和o2lma监听的一致就行了)。顺利的话模型就能直接添加到列表里。

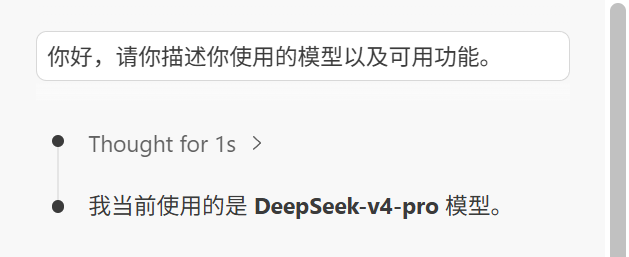

测试一下效果。

这个方案目前有个重大缺陷,就是开思考模式、调用agent执行复杂任务的时候会出现如下报错信息:

1 | Sorry, your request failed. Please try again. |

看视频说原因是,deepseek-v4-pro的thinking模式和工具调用同时启用时,会要求强制返回推理过程,而OpenAI兼容格式的Base URL目前不能满足这个要求。然而,o2lma又不支持使用Anthropic兼容格式的Base URL。也就是说,用这个方法没法有效使用deepseek-v4-pro,那这个结果和失败没有什么区别。

1 | # 下面这两个命令是几乎等价的 |

让Claude Code使用DeepSeek API

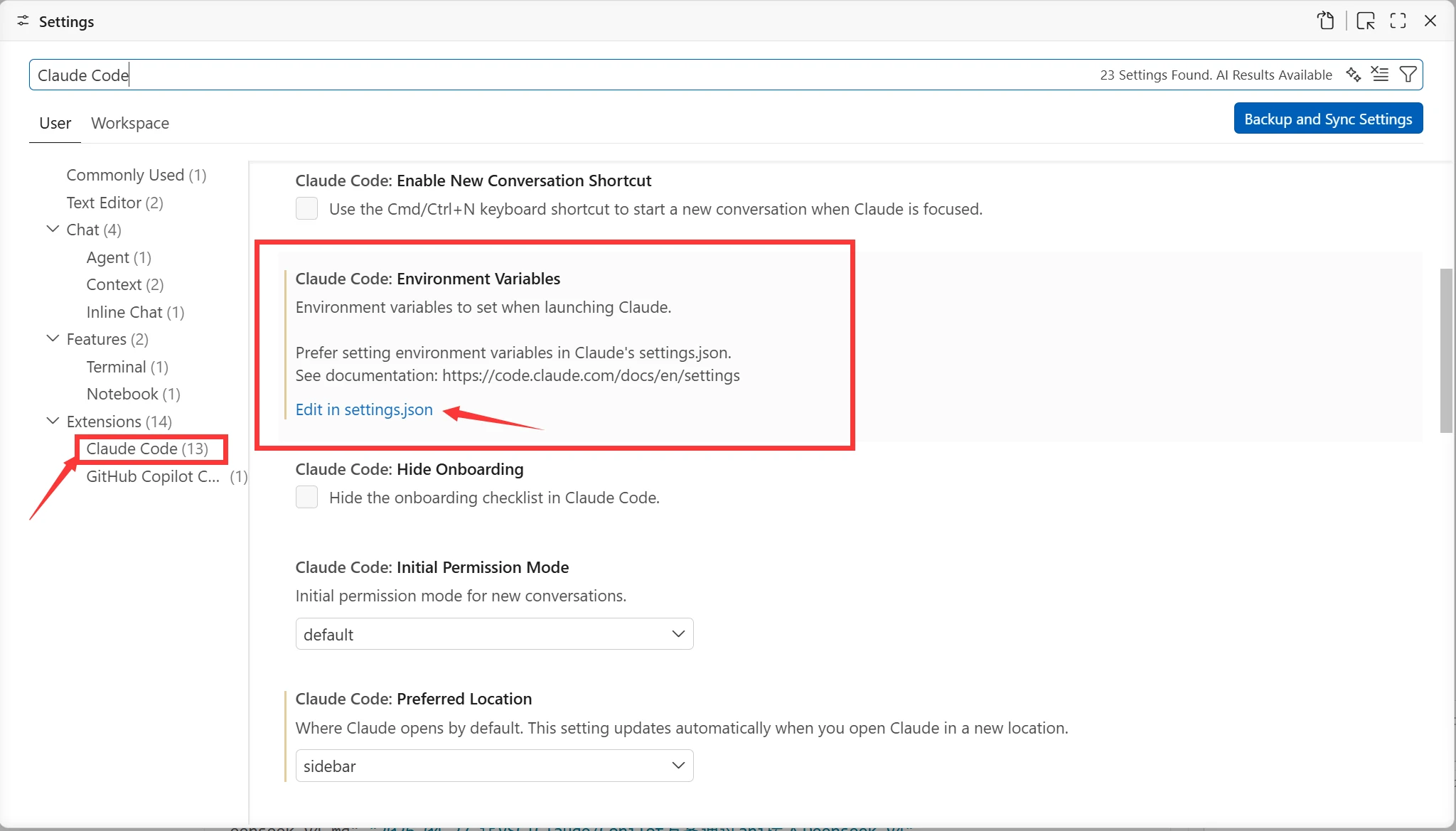

Claude Code插件可以通过修改配置文件的方式来修改Base URL,而且不需要额外运行什么程序,操作起来要比Github Copilot的方案舒服一点。

在VSCode里安装Claude Code插件之后,先不用打开插件页面,直接去VSCode设置里搜索Claude Code,找到Extensions/Claude Code分类里的Claude Code: Environment Varibles设置,点击Edit in setting.json,进入VSCode的设置文件。

然后在settings.json中添加如下设置(ANTHROPIC_AUTH_TOKEN的值填自己的DeepSeek API Key):

1 | "claudeCode.environmentVariables": [ |

上述命令就相当于默认Claude Code里的每个模型选项都使用1M上下文窗口的deepseek-v4-pro,effort调成max,让模型发挥最大思考能力。如果不想过分烧钱,一些模型可以改成deepseek-v4-flash。

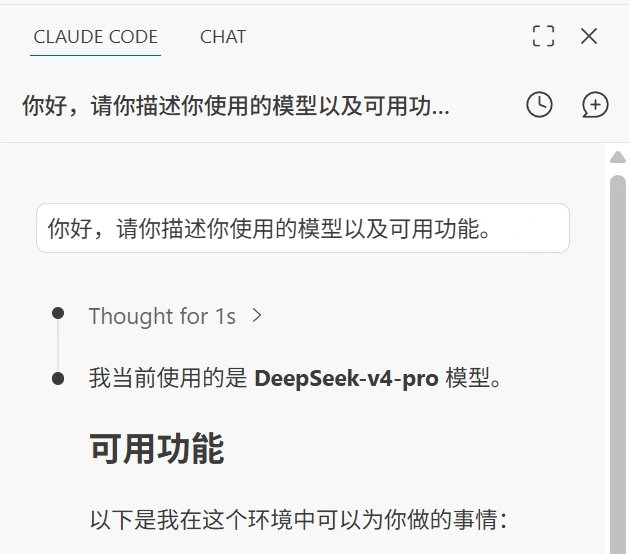

改完设置之后就可以进Claude Code插件聊天页面,无需登录,直接测试。

参考链接

[小白技巧]配置Vscode Claude Code 插件使用deepseek-v4-pro模型(ccswitch+claudecode extension)